BSA成员还包括了Adobe、IBM和甲骨文等科技公司。

【围攻ChatGPT】:AI狂飙突进,我们该注意哪些风险?

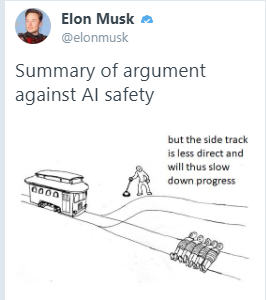

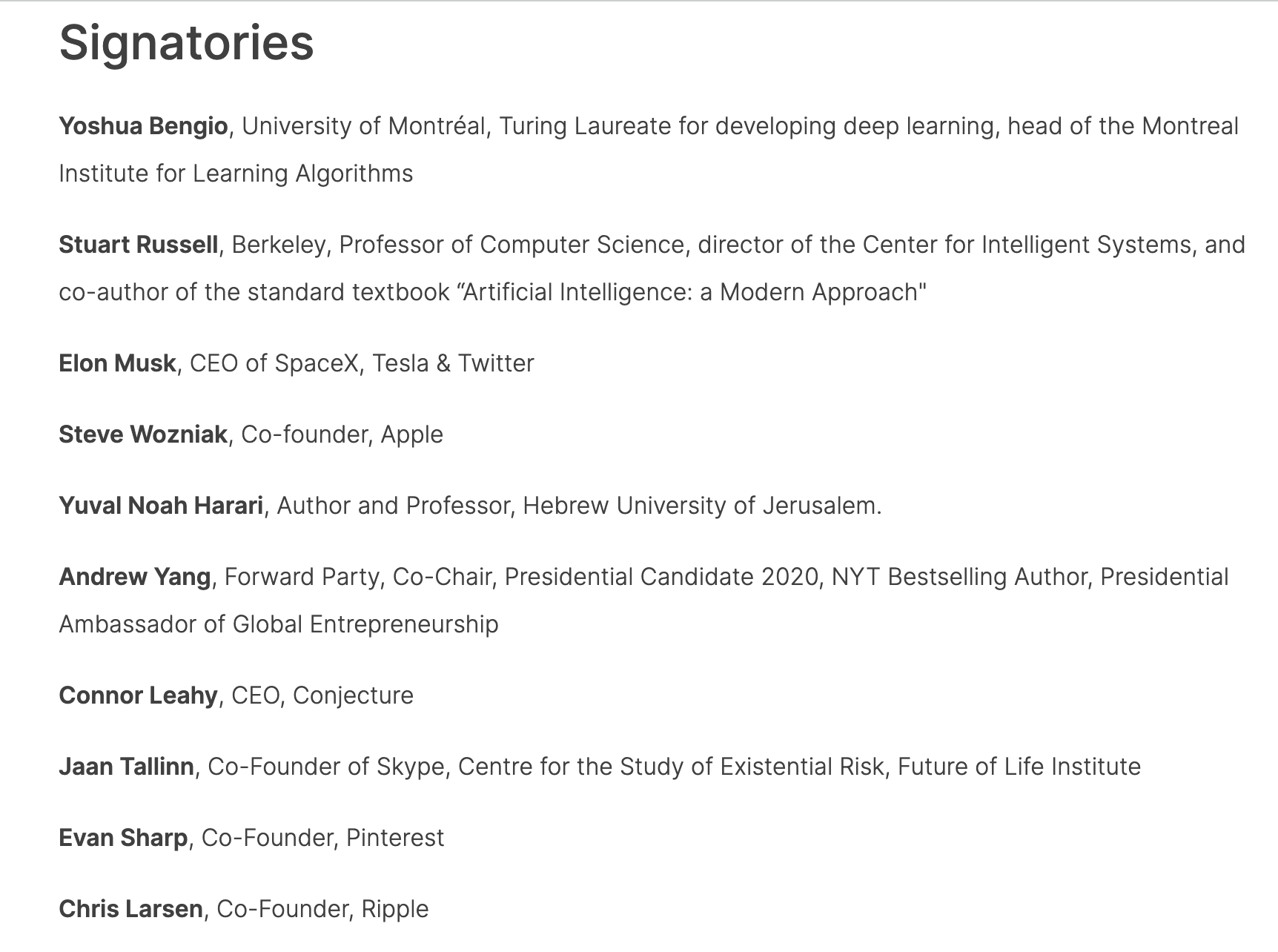

ChatGPT自推出以来,发展迅猛,不仅激发了人工智能研发热潮,更是掀起了关于人工智能伦理与风险的讨论。先是马斯克等人签署联名公开信叫停大型AI研究,再有外媒报道称,自意大利于3月31日封禁ChatGPT后,德国数据保护专员称,出于数据安全考虑,可能将效仿意大利的做法。法国和爱尔兰的隐私监管机构也表示,正与意大利数据监管机构探讨禁令依据。不少人工智能相关从业者甚至支持人工智能“末日论”,但有评论认为应警惕技术讨论背后隐藏的目的。

第246期