据外媒The Information报道,微软计划在下个月举行的年度开发者大会上推出首款AI专用芯片。这不是微软的一时兴起,而是多年来努力的结果,将来会帮助微软逐步减少对英伟达的依赖。近几年,特别是最近大半年AIGC的浪潮兴起,相关需求一路激增不见终点,英伟达的AI芯片一直供不应求,是各家AI相关高新科技企业都在争夺的香饽饽。

微软早在2019年左右就已开始相关研发工作了,有传言说OpenAI已经秘密测试过。根据目前已有的信息可知,这款芯片代号为“雅典娜”(Athena),与英伟达的GPU多有相似之处,是专为训练和运行大模型的数据中心服务器设计的,微软在此芯片的研发投入已累计近20亿美元。现在微软的数据中心服务器用的都是英伟达GPU,是英伟达为数众多大客户之一,为包括OpenAI和Intuit在内的云客户,以及微软生产力应用中的AI功能提供支持。自从和OpenAI合作以后,很快就有消息称微软曾一次性就订购了至少几十万颗英伟达芯片,用于对GPT的训练。

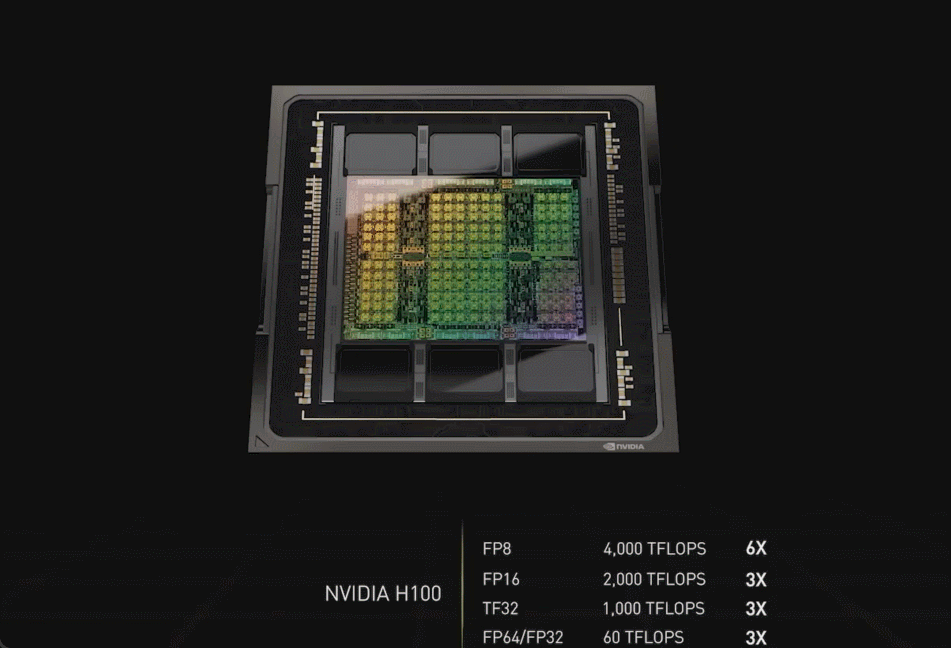

有消息称微软可能会在11月中旬时,于西雅图举行的微软开发者大会上正式公布此芯片。削减成本,减少依赖的同时,微软也希望增加与英伟达谈判的筹码。一旦“雅典娜”能顺利实现量产,微软就可以很快赶上竞争对手亚马逊和谷歌的脚步,向用户提供更好的服务。现在“雅典娜”的性能细节尚未披露,但从微软的角度来说肯定是希望它能与英伟达的H100相媲美,甚至超越。尽管现在有不少公司都在兜售自家卓越的硬件和成本效益,但得益于自家的CUDA平台,英伟达的GPU仍然是全球广大AI开发者的首选。

这么看来,微软“雅典娜”能成事的关键,就在于吸引用户接受并使用它的新硬件和软件。虽然微软、谷歌等诸多云服务提供商目前仍在购买英伟达的GPU,但从长远来看,推出自研芯片再说服他们的云客户采用,明显比继续用英伟达的GPU服务器更有利,不论是在经济性上还是在对未来的规划上。随着AI与AIGC工作量的激增,这种多样化的方法提供了多种选择,云计算的各家竞争对手也在采用类似的策略来避免供应商锁定。

英伟达H100

之前曾经多次说过,亚马逊和谷歌都在逐步的将其AI芯片与云业务的多种活动战略性地整合到一起。比如亚马逊向OpenAI的竞争对手Anthropic提供40亿美元的资金支持,条件是Anthropic将使用亚马逊的两款AI芯片,分别名为Trainium和Interentia。几乎同时的,谷歌云也宣布,AI图像开发商Midjourney和Character AI等客户都在使用谷歌的张量处理单元,加速自己的机器学习进程。之前几周,微软也曾表示与AMD在即将推出的AI芯片MI300X上保持密切合作。

眼下随着AIGC逐渐成为不可阻挡的势头,AI芯片也自然而然的成为数据中心的重要组成部分,引起各大科技企业的关注,而且英伟达等企业也用自己的实际表现证明了,该领域的投入产出比可能会异乎寻常的高。现在随着亚马逊、微软等企业的逐个下场,这一赛道的竞争也在愈发激烈,在加速发展的AI芯片领域争夺市场份额。有了“雅典娜”,微软可以为云客户提供更多的选择,同时在下一代AI基础设施方面也可以逐渐摆脱英伟达的掣肘。

前几天曾有消息爆料,称OpenAI也在探索自研AI芯片,同时开始评估潜在收购目标,其招聘网站上最近也出现了AI硬件共同开发、评估相关岗位的广告。而前面提到过,当前的GPU市场是英伟达一家独大,市场份额占绝对优势。而且GPU不仅贵还不好买,自研AI芯片也意味着能大幅降低算力成本。

值得说明的一点是,微软和OpenAI的造芯是彼此独立的,一旦二者都入局芯片市场,此后的地位也将发生微妙变化,因此也有人认为这可能会导致二者间更大的矛盾。虽然明面上看起来微软与OpenAI可谓天作之合、亲密无间,但实则完全是同床异梦。且不说New Bing和ChatGPT已经持续了半年多的用户之争,微软曾经在夏天时为OpenAI的竞争对手Meta和LLaMA 2投入一笔重资,OpenAI的心里会是什么感受,多少留了根刺吧?

不过这些矛盾现在可能都不重要了,微软和OpenAI至少目前在一件事上达成了一致:不能再让老黄这么肆无忌惮的大赚特赚了,正如老话所说,看着好兄弟挣钱,比数着自己赔钱还难受。

本文链接:https://www.aixinzhijie.com/media/6834728

转载请注明文章出处